Mit Skin Check ermöglichen wir eine einfache Hautkrebs-Früherkennung auf dem Smartphone

Immer mehr Menschen in Deutschland erkranken und sterben an Hautkrebs. Dennoch bezahlen gesetzliche Krankenkassen ein Hautkrebs-Screening erst ab einem Alter von 35 Jahren. Wir suchen nach einer Lösung, die auch jüngeren Menschen einen kostenfreien und mobilen Indikator für Hautkrebs (malignen Melanom) bietet.

Die entwickelten Web, Android und iOS Apps ermöglichen den Benutzer:innen, ein kostenloses Hautkrebs-Screening auf ihrem Smartphone oder Computer durchzuführen. Eine skalierbare KI im Hintergrund sorgt für die Kategorisierung der aufgenommenen Bilder. Damit schafft sie den Anwendenden Klarheit über Leberflecke, Muttermale und andere Flecken auf ihrer Haut.

Für die Entwicklung dieser Applikation waren mehrere Bereiche notwendig. Das erste Ziel war die Erstellung eines intuitiven Frontends. Dieses steht zum einen als Web-Applikation zur Verfügung sowie als Android und iOS-App. Dadurch besteht keine Notwendigkeit für die Benutzer:innen eine App zu installieren. Für das bessere Nutzungserlebnis steht ihnen die Möglichkeit aber offen.

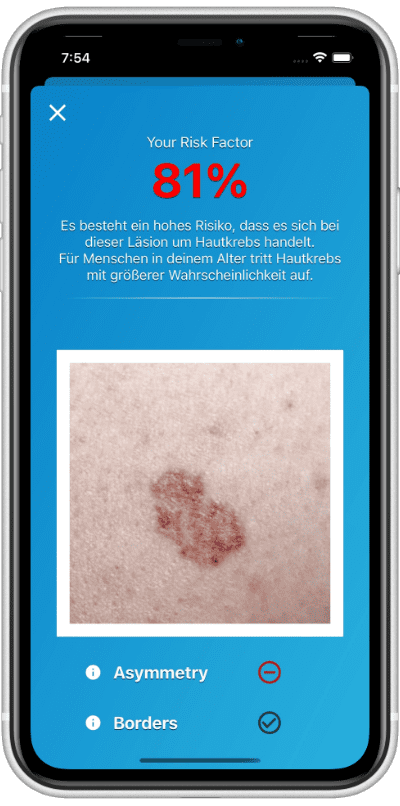

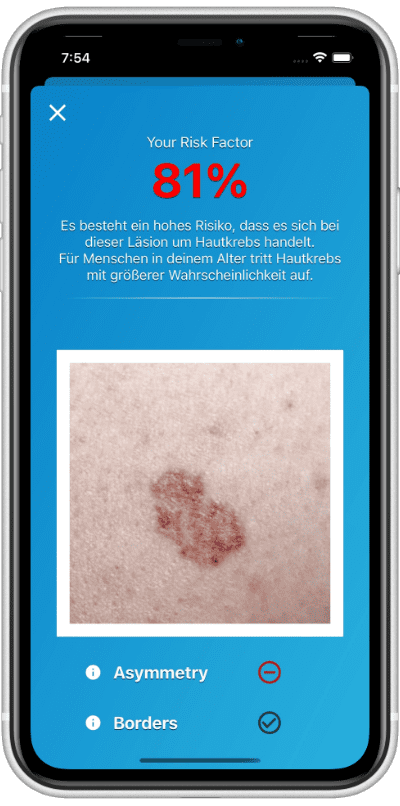

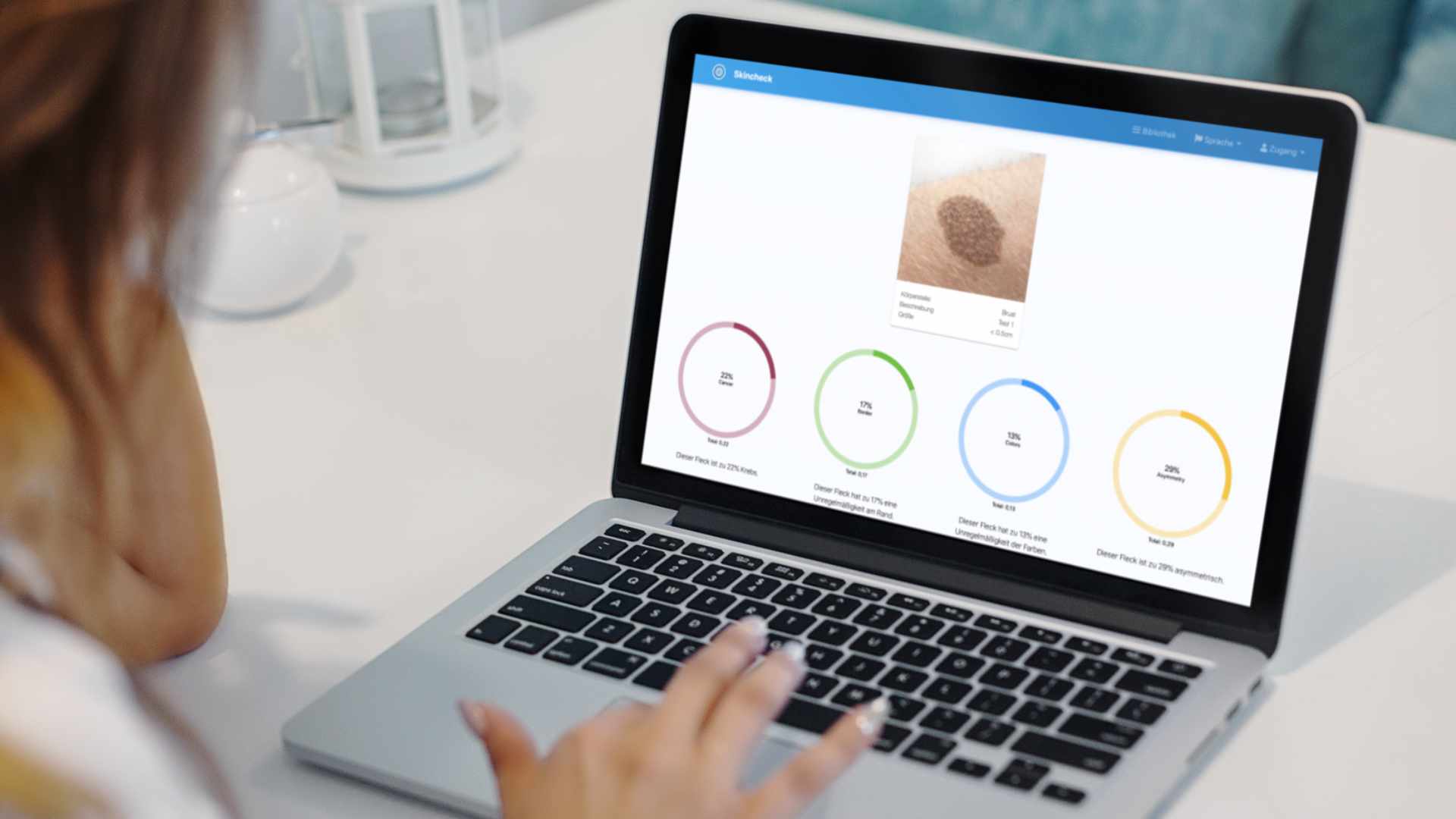

In der Hautkrebs-Früherkennungs-Applikation ist das Aufnehmen sowie Hinzufügen neuer Bilder möglich, sodass eine Analyse über unsere Künstliche Intelligenz stattfinden kann. Neben dem Bild ist es auch wichtig, die jeweilige betroffene Körperstelle sowie die Größe des Flecks anzugeben. Die Bewertung des Bildes unterliegt der ABCDE-Regel, welche folgende Parameter abdeckt:

Aus den Kriterien wird eine Prognose erstellt. Diese gibt die Wahrscheinlichkeit an, dass es sich bei dem untersuchten Fleck um Hautkrebs handelt. Dies schafft den Benutzer:innen eine direkte Einsicht in das Risiko.

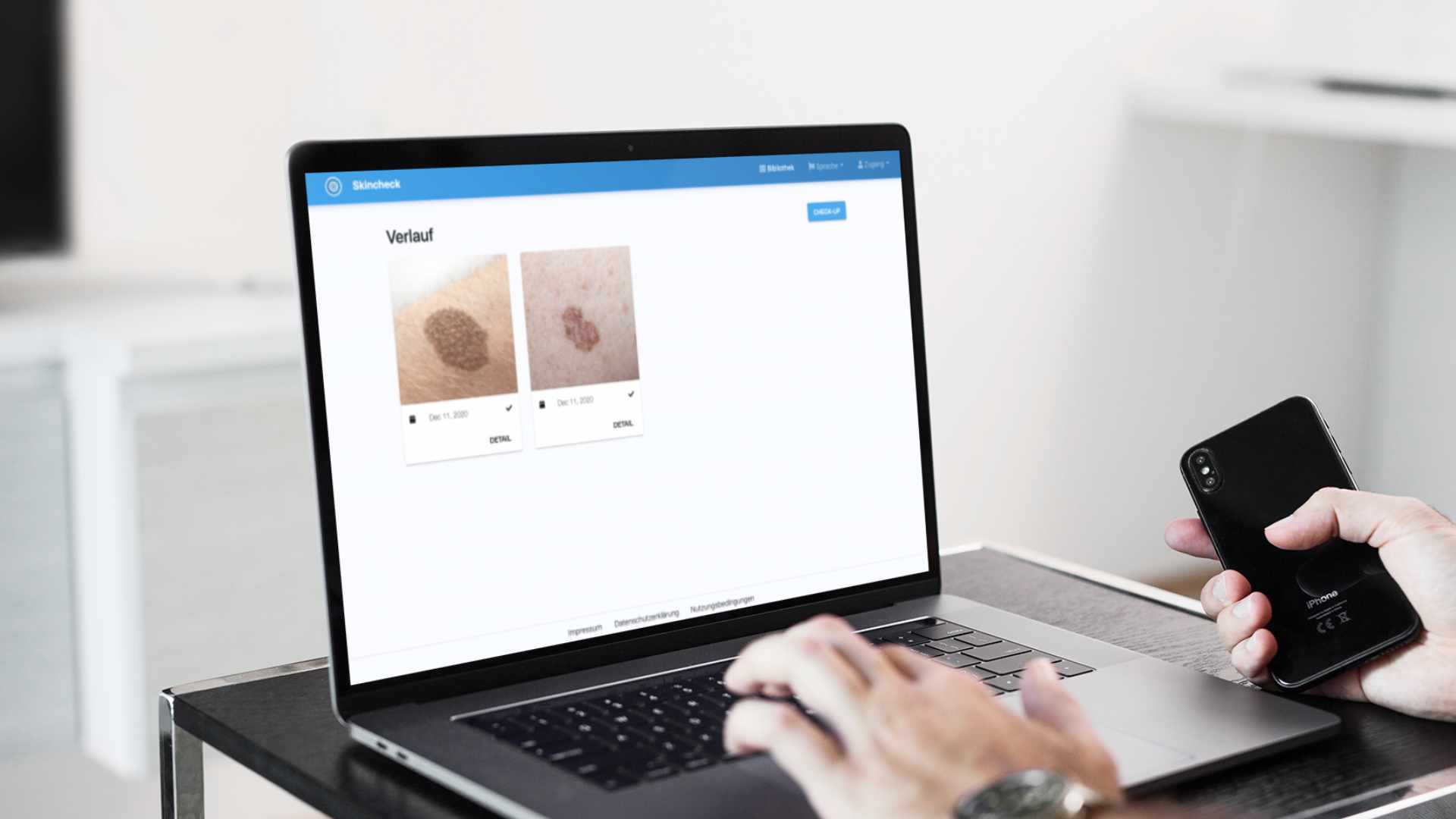

Des Weiteren steht eine automatische Erinnerungsfunktion zur Verfügung, umgesetzt durch Push-Nachrichten. Diese erinnert nach einem gewissen Zeitabstand die User:innen, sich einer erneuten Analyse des Pigments zu unterziehen. Das soll einer unerkannten, bösartigen Entwicklung des Fleckes vorbeugen. In einer Übersicht stehen den Nutzenden der gesamte Verlauf eines Hautpigments sowie alle Screening Ergebnisse zur Ansicht bereit.

Für die individuelle Speicherung der Ergebnisse ist ein Account notwendig. In diesem ist das Hinterlegen weiterer Faktoren wie das Alter möglich. Dieses kann ebenfalls in die Analyse miteinfließen. Die Applikation sowie ihre Inhalte unterliegen den datenschutzrechtlichen Bestimmungen.

Die Generierung des Web-Frontends und Backends ist mit jHipster, einem Frontend und Backend Generierungstool, entstanden. Hierbei kommt für das Frontend Angular zum Einsatz, ein Framework für Web-Anwendungen. Die Android App entwickelten wir dagegen nativ mit Kotlin und die iOS App mit Swift.

Mit Hilfe von Microservices schaffen wir eine skalierbare Backend Lösung. Zum Erfolg von Skin Check führt die Anwendung von Neuronalen Netzen.

Das generierte Backend besteht aus mehreren Microservices. Dabei handelt es sich um kleine Services, die jeweils nur einen minimalen Funktionsumfang beinhalten und mit anderen Services kommunizieren. Damit das Backend optimal auf sich ändernde Bedingungen anpassbar ist, sind einzelne Services skalierbar. Beispielsweise besteht jeweils ein einzelner Service für die vier oben genannten Bewertungskriterien.

Jeder Microservice stellt eine einzelne Spring Boot Applikation dar, die wir mit Hilfe von Java entwickelten. Die Daten wie der Account und die Ergebnisse der Analyse sind in einer SQL-Datenbank mit dem Namen MariaDB gespeichert.

Präzise Vorhersagen über die aufgenommenen Bilder sind essenziell. Hierfür implementierten wir als KI ein Neuronales Netz, genauer ein Convolutional Neural Network (CNN). Diese sind für die Bildverarbeitung optimiert und erlernen gezielt, Merkmale aus den Bildern zu extrahieren. Wir trainierten mittels Deep-Learning für jede der vier Vorhersagen ein eigenes Neuronales Netz. Die beigebrachten Eigenschaften ermöglichen eine gezielte Kategorisierung von neuen Bildern und somit eine Einschätzung des Risikos.

Für die Erstellung und das Training des CNN verwendeten wir die Deep-Learning-Bibliotheken Keras und TensorFlow. Die Modelle trainierten wir in der Programmiersprache Python mit Hilfe der zwei genannten Bibliotheken. Anschließend importierten wir die Modelle in Java. So konnten wir direkt in der Spring Boot Applikation neue Vorhersagen treffen.